Наращивание компетенций:учёные из Дагестана представили систему для идентификации дипфейков

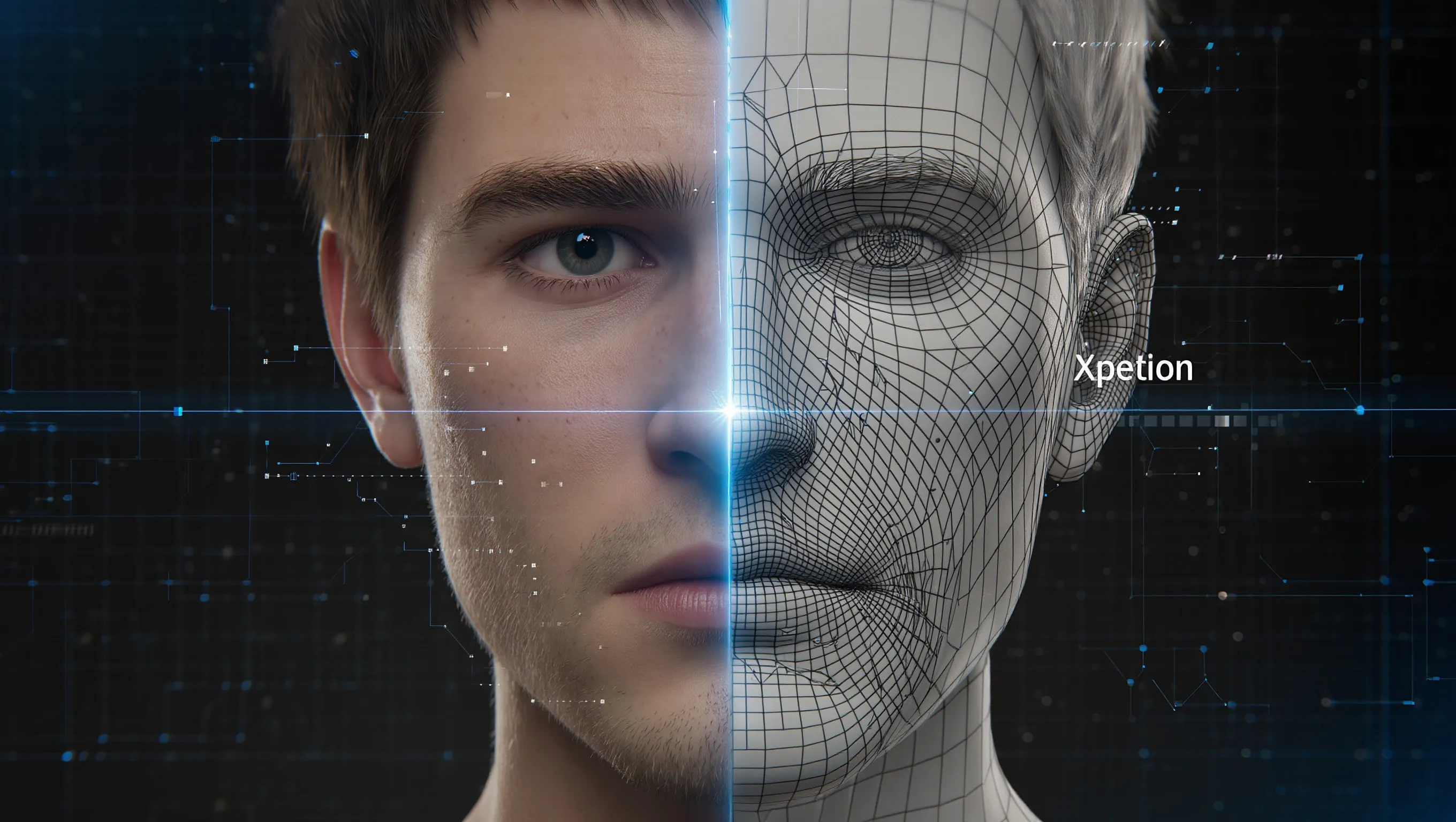

Учёные Дагестанского государственного университета (ДГУ) презентовали систему на базе нейросетей для идентификации дипфейков. Модель Xception показала оптимальное сочетание точности (88,5%) и быстродействия (89 мс на кадр).

Большое будущее

Разработка является актуальной из-за природы дипфейков – высокореалистичного контента, созданного с помощью генеративно-состязательных сетей (GAN) для имитации внешности и речи человека. Дипфейки способны вводить людей в заблуждение, чем пользуются мошенники для хищения персональных данных и денег населения, также их используют злоумышленники для подрыва доверия населения к официальным источникам информации и дезинформации граждан. Поэтому создание надёжных методов автоматического распознавания фальсифицированного видео критически важно для обеспечения цифровой безопасности.

Отечественные исследования в этой области укрепляют научный суверенитет в сфере защиты ИИ и способствуют развитию базы для подготовки кадров в сфере компьютерного зрения и медиа-криминалистики. Что касается перспектив на международном уровне, то модернизация алгоритмов детекции востребована во всем мире, поэтому у проекта есть большое будущее.

Фундамент развития технологий

Российскую разработкуможно совместить с зарубежными технологиями в области медиа-криминалистики благодаря ориентации на международный стандарт данных DFDC. Также открывается дорога к созданию экспортноориентированного программного обеспечения. Алгоритмы обладают широким спектром практического применения. Их можно интегрировать в соцсети и видеохостинги или встроить в системы видеонаблюдения и специализированные инструменты для СМИ, служб корпоративной безопасности, силовых структур.

В целом проект закладывает фундамент для развития в стране технологий высокоточной верификации контента. Они призваны помочь в борьбе со сложными методами цифрового синтеза. Но важно понимать, что современные методы детекции нуждаются в постоянной модернизации из-за регулярного усложнения способов генерации подделок.

С этой сложностью сталкиваются во всём мире, о чем говорят зарубежные исследования. Поэтому приоритетом сейчас является поиск решений, способных минимизировать уязвимость систем перед инновационными стратегиями фальсификации. Другая важная задача – обеспечение стабильной работы алгоритмов в живой информационной среде.

Мировой опыт

В научной среде ведётся работа над нейросетями разных архитектур для борьбы с дипфейками. Учёные разрабатывают методы, которые анализируют контент и выявляют аномалии, указывающие на подделку. Среди методов – сопоставление движения губ человека со звуками, которые он произносит, анализ параметров аудиозаписи и т.д. Один из первых алгоритмов использовал анализ несовместимых признаков внутри изображения для обнаружения дипфейков, повышая точность на разных датасетах.

Исследователи предложили методы, которые выделяют локальные признаки манипуляции, чтобы повысить обобщаемость алгоритма на неизвестные данные. Так, применение ансамбля CNN-Caps Net способствует более эффективному распознаванию сложных объектов, даже при частичном закрытии, изменении ракурса или масштабе.

Растет исследовательский потенциал высших учебных заведений в сфере медиа-аналитики. Например, исследование Научно-исследовательского института искусственного интеллекта AIRI совместно с НИУ ВШЭ (2024) рассказывает о методах повышения точности обнаружения и распознавания 3D-объектов. Учёные экспериментально подтвердили преимущества использования малых генеративных моделей ИИ, обученных на качественном наборе данных, для дальнейшего обучения больших моделей искусственного интеллекта и решения задач 3D-детекции. Согласно исследованию «На пути к генерализованному Deepfake Detection с помощью локального автоэкономера», LAE превосходит самые современные показатели на 6,52%, 12,03% и 3,08% соответственно по трем задачам обнаружения дипфейков с точки зрения точности обобщения при ранее невиданных манипуляциях.

Создание национальной ИИ-платформы

Работа учёных ДГУ важна для развития отечественных компетенций в сфере безопасности искусственного интеллекта. В рамках исследований были применены признанные международные датасеты, благодаря чему удалось верифицировать российские разработки на глобальном уровне. Данные оказались сопоставимы с зарубежными аналогами. Показатель точности в 88,5% указал вектор дальнейших изысканий. Алгоритмы требуют дополнительной оптимизации и доработки. Только при таком раскладе удастся достичь максимальной эффективности.

Эксперты планируют в ближайшие пару лет углубить исследования и разработать первые тестовые сервисы для верификации медиаконтента. В перспективе трех-пяти лет фокус сместится на создание адаптивных моделей, которые смогут противостоять новым типам синтеза, а также на коммерциализацию решений. В долгосрочной перспективе исследования могут послужить основой создания национальной ИИ-платформы, способной автоматизировать мониторинг информационного пространства.Это станет способом уберечься от масштабных фальсификаций.