Виртуальный помощник «Ева» от «МегаФона» начала распознавать голосовые дипфейки

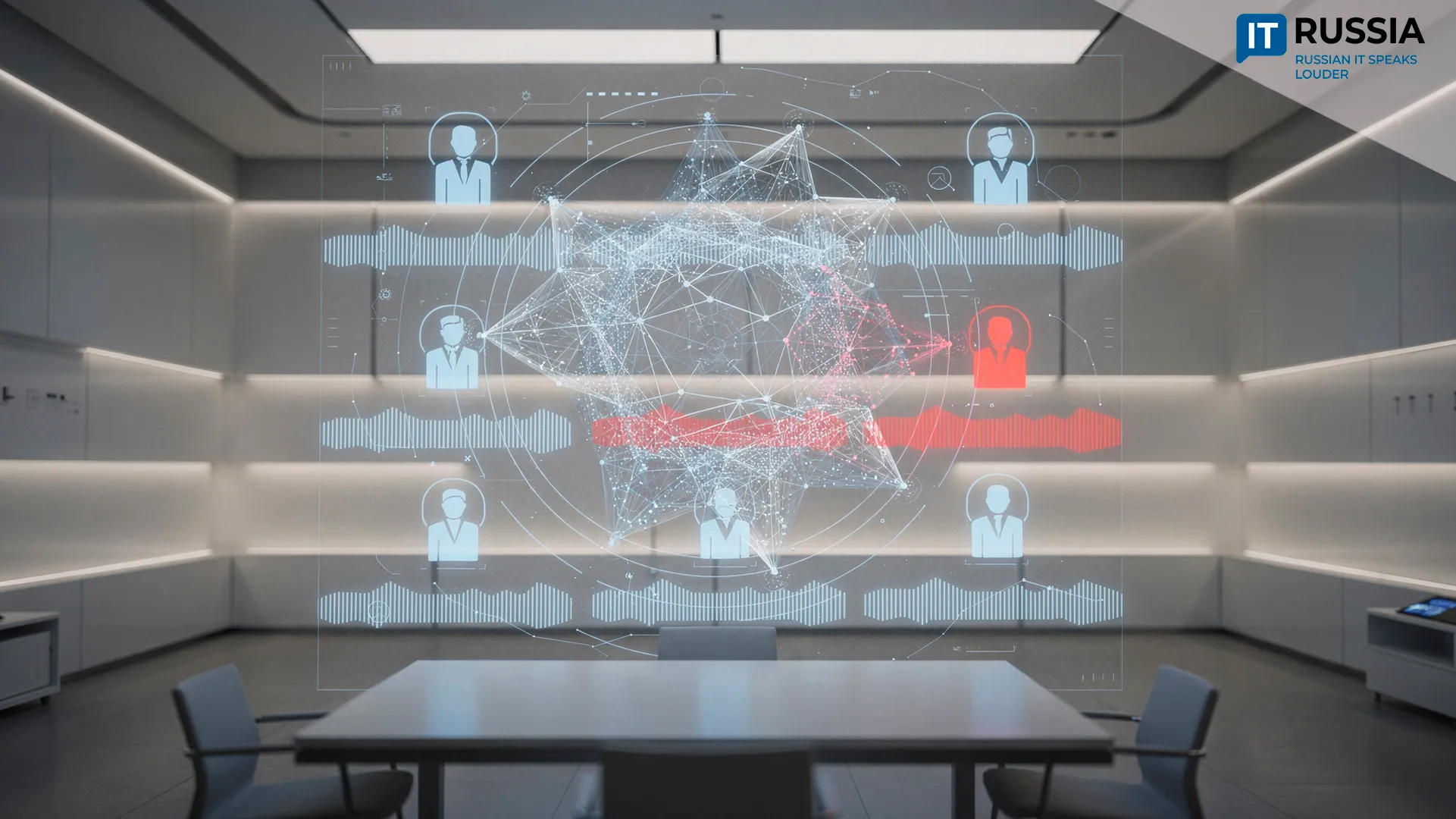

«МегаФон» обновил виртуального помощника «Еву», добавив функцию распознавания синтезированной речи и голосовых дипфейков в реальном времени. Система анализирует параметры звука во время разговора и предупреждает пользователя, если на линии робот или возможная подделка голоса. Сервис способен отличать сервисные уведомления от потенциально мошеннических звонков.

Новые возможности виртуального помощника «Евы» – важный шаг в развитии потребительских антифрод-решений. Вместо лабораторного эксперимента – реальная функция в телеком-сервисе для широкой аудитории, особенно актуальная на фоне роста телефонного мошенничества и распространения ИИ-подделок. Проект объединяет телеком, цифровую безопасность и ИИ.

Система помогает вовремя распознать попытку обмана при подделке голоса знакомого или официального лица. В этом заключается практическая ценность для пользователей. Для рынка это шаг к более зрелой инфраструктуре защиты на уровне операторов, а не только финансовых структур. В глобальном контексте проект можно рассматривать как кейс, где ИИ становится инструментом защиты, а российский телеком демонстрирует прикладной сценарий, способный масштабироваться за пределами страны.

Новый стандарт цифровой гигиены

Основной эффект от решения – инфраструктурный. Если функция покажет низкий уровень ложных срабатываний и войдет в связку с маркировкой, антифродом и клиентскими уведомлениями, то сможет стать новым стандартом цифровой гигиены для операторов. На фоне роста телефонного мошенничества и активного использования дипфейков, о чем отдельно предупреждал Банк России, массовых защитных инструментов до сих пор не хватало. «Ева» с новыми функциями закрывает этот запрос.

Следующий шаг – интеграция детектирования синтетического голоса в многослойные антифрод-схемы: с учетом анализа номера, поведения абонента, сценария разговора и истории взаимодействий. Отечественный рынок движется в эту сторону. Госсистема «Антифрод» верифицирует заметную долю звонков, а регулирование в области интернет-телефонии ужесточено. Это поддерживает тенденцию к сквозной защите голосового канала.

У решения есть экспортный потенциал, он связан в первую очередь со зрелостью антифрод-платформ. В перспективе востребованы движки анализа, модели классификации синтетической речи и B2B-платформы для операторов и контакт-центров, в том числе на рынках СНГ, Ближнего Востока, Азии и Африки, где фиксируется рост голосового мошенничества.

Проблема voice deepfake fraud

В 2024 году госсистема «Антифрод» в России вышла на промышленный масштаб. По данным Роскомнадзора, за 9 месяцев она заблокировала около 577 млн вызовов с подменных номеров, а к концу года ежедневно верифицировала сотни миллионов звонков. Рынок переходит к контролю подлинности самого голоса и содержания разговора. Одновременно в 2024–2025 годах усиливается регуляторный контур. Постановление правительства от 26 декабря 2024 года оптимизировало лицензирование связи, ограничив использование интернет-телефонии в мошеннических схемах, что демонстрирует двусторонний подход к борьбе с голосовым мошенничеством – через нормативные меры и через технологические решения операторов.

В 2025 году Сбер объявил о собственных технологиях выявления дипфейков и готовности делиться решениями автоматического детектирования поддельного контента, отдельно выделив сервис «Алетейя» для поиска видеодипфейков. Банки и телеком-операторы зафиксировали новый рубеж: эпоха ИИ-мошенничества требует специализированных детекторов фейкового аудио- и видеоконтента.

В 2025–2026 годах аналитики отметили рост интереса злоумышленников к deepfake-сценариям, а крупные игрокипрогнозируют усиление атак с использованием клонирования голоса и персонализированных схем. Параллельно международная повестка смещается к проблеме voice deepfake fraud. Европарламент фиксирует рост угрозы scamcalls в эпоху генеративного ИИ и связывает аудио- и видеодипфейки с реальными финансовыми потерями. Таким образом, российские инициативы становятся реальным инструментом борьбы с мошенничеством.

Защита от эмоционально опасных схем

Разработка является маркером новой стадии рынка цифровой безопасности. Раньше фокус был направлен на блокировку подменных номеров и спам-звонков, сейчас же на первый план выходит проверка подлинности голоса и содержания разговора – класс задач, который будет расти вместе с генеративным ИИ.

Ожидается, что в ближайшее время отечественные операторы, банки и экосистемы начнут развивать AI-vs-AI-подход, когда нейросети используются и мошенниками для атаки, и для защиты от атак. Потенциальная конфигурация – три слоя: маркировка и верификация звонка, детектирование синтетического голоса и поведенческий анализ риска по сценарию общения. Разработка «МегаФона» даёт россиянам дополнительную защиту от эмоционально опасных схем, основанных на доверии к «знакомому» голосу.

Российский телеком внедряет прикладные ИИ-механизмы безопасности в массовый сервис, что говорит о цифровом суверенитете и зрелости антифрода.